НАИМЕНЬШИХ КВАДРАТОВ МЕТОД

один

из методов ошибок теории для оценки неизвестных величин по результатам

измерений, содержащим случайные ошибки. H. к. м. применяется также для

приближённого представления заданной функции другими (более простыми) функциями

и часто оказывается полезным при наблюдений обработке. H. к. м.

предложен К. Гауссом (1794-95) и А. Лежандром (1805-06).

Первоначально H. к. м. использовался для обработки результатов астрономич.

и геоде-зич. наблюдений. Строгое матем. обоснование и установление границ

содержательной применимости H. к. м. даны А. А. Марковым (старшим)

и A. H. Колмогоровым. Ныне H. к. м. представляет собой один из важнейших

разделов матем. статистики и широко используется для статистич. выводов

в различных областях науки и техники.

Сущность обоснования H. к. м. (по Гауссу)

заключается в допущении, что "убыток" от замены точного (неизвестного)

значения физ. величины её приближённым

её приближённым

значением X, вычисленным по результатам наблюдений, пропорционален

квадрату ошибки: (X - )2.

)2.

В этих условиях оптимальной оценкой естественно признать такую лишённую

систематич. ошибки величину X, для к-рой среднее значение "убытка"

минимально. Именно это требование и составляет основу H. к. м. В общем

случае отыскание оптимальной в смысле H. к. м. оценки X - задача весьма

сложная, поэтому практически эту задачу сужают и в качестве X выбирают

линейную функцию от результатов наблюдений, лишённую систематич. ошибки,

и такую, для к-рой среднее значение "убытка" минимально в классе всех линейных

функций. Если случайные ошибки наблюдений подчиняются

нормальному распределению

и

оцениваемая величина зависит от средних

зависит от средних

значений результатов наблюдений линейно (случай, весьма часто встречающийся

в приложениях H. к. м.), то решение этой задачи будет одновременно являться

и решением общей задачи. При этом оптимальная оценка

X

также подчиняется

нормальному распределению со средним значением

и, следовательно, плотность вероятности случайной величины X

(х;

(х; ,

, )

)

= (1/SQR(2 )

) )

)

(-[(x-

(-[(x- )/

)/ ]2/2)

]2/2)

при х=Х достигает максимума в точке

= X (это свойство и выражает точное содержание распространённого

в теории ошибок утверждения "оценка X, вычисленная согласно H. к.

м.,- наиболее вероятное значение неизвестного параметра ).

).

Случай одного неизвестного. Пусть для

(коэффициент k > 0 можно выбирать

Сумма S (X) будет наименьшей,

Оценка Y величины При нек-рых общих предположениях можно

[напр., I (1,96) = 0,950; I (2,58)

Если веса измерений (обе оценки лишены систематич. ошибок).

где постоянная C Пример. Для определения массы нек-рого

(здесь n Случаи нескольких неизвестных (линейные

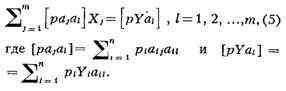

где а Так как Е Следовательно, искомые величины x Согласно H. к. м., в качестве оценок

будет наименьшей (как и в предыдущем

не могут, вообще говоря, все обратиться

Сумма квадратов S представляет собой

Отсюда следует, что оценки X Оценки X предположениях можно показать, что

не зависят от самих оценок X Один из наиболее типичных случаев применения

Пример. Для оценки точности одного

Если результаты хим. анализа не имеют

Для отыскания оценок Y Дисперсии компонент решения этой системы

где k - неизвестная дисперсия

Если случайные ошибки наблюдений подчиняются

Во многих практически важных случаях

Лит.: Марков А. А., Исчисление

А

Б

В

Г

Д

Е

Ё

Ж

З

И

Й

К

Л

М

Н

О

П

Р

С

Т

У

Ф

Х

Ц

Ч

Ш

Щ

Ъ

Ы

Ь

Э

Ю

Я

оценки значения неизвестной величины

произведено

n

независимых наблюдений, давших результаты Y

+

+

случайные ошибки - независимые случайные величины с нулевым математическим

ожиданием: Е

если же Е

то Е

ошибками). Согласно H. к. м., в качестве оценки величины

принимают такое X, для к-рого будет наименьшей сумма квадратов (отсюда

и само название метода):

произвольно). Величину p

если все измерения равноточны, то

=

и в этом случае можно положить 1

1

=

измерений, то полагают i =

i =

ni.

если в качестве X выбрать взвешенное среднее:

![]()

лишена систематич. ошибки, имеет вес P и дисперсию DY = k/Р. В частности,

если все измерения равноточны, то Y - арифметич. среднее результатов измерений:

![]()

показать, что если количество наблюдений n достаточно велико, то

распределение оценки Y мало отличается от нормального с математич. ожиданием

и дисперсией k/P. B этом случае абс. погрешность приближённого равенства

=

=

Y меньше

t SQR(k/P) с вероятностью, близкой к значению интеграла

![]()

= 0,990; I (3,00) = 0,997].

i

i

заданы, а множитель

k

до наблюдений остаётся неопределённым, то

этот множитель и дисперсия оценки Y могут быть приближённо оценены по формулам:

![]()

В том практически важном случае, когда ошибки ,

,

подчиняются нормальному распределению, можно найти точное значение вероятности,

с к-рой абс. погрешность приближённого равенства

Y

окажется меньше ts (t - произвольное положительное число). Эту вероятность,

как функцию от t, наз. функцией распределения Стьюдента с n -

1 степенями свободы и вычисляют по формуле:

![]()

таким образом, чтобы выполнялось условие: I

1. При больших n формулу (2) можно заменить формулой (1). Однако

применение формулы (1) при небольших n привело бы к грубым ошибкам.

Так, напр., согласно (1), значению I = 0,99 соответствует t = 2,58;

истинные значения t, определяемые при малых n как решения соответствующих

уравнений I

тела произведено 10 независимых равноточных взвешиваний, давших результаты

Y

г):

случаев, в к-рых наблюдался вес Yi, причём n = n

n i

i

= n

выбрать величину Y = n

n

распределения Стьюдента с девятью степенями свободы можно найти, что t

= 2,262, и поэтому в качестве предельной абс. погрешности приближенного

равенства 18,431 следует

18,431 следует

принять величину

![]()

связи). Пусть n результатов измерений Y

отношениями

![]()

коэффициенты, а

x

задачу можно рассматривать как обобщение предыдущей, в к-рой

= x

т = а

О, то средние значения результатов измерений y

с неизвестными величинами x

уравнениями (линейные связи):

![]()

собой решение системы (4), уравнения к-рой предполагаются совместными.

Точные значения измеряемых величин у

обычно неизвестны, поэтому вместо систем (3) и (4) принято записывать т.

н. условные уравнения

![]()

для неизвестных x

к-рых сумма квадратов отклонений

![]()

случае,

Y

Условные уравнения, как правило, несовместны, т. е. при любых значениях

X![]()

в нуль, и в этом случае S =

также не может обратиться в нуль. H. к. м. предписывает в качестве оценок

выбрать такие значения X

В тех исключительных случаях, когда условные ур-ния совместны и, значит,

обладают решением, это решение совпадает с оценками, полученными согласно

H. к. м.

квадратичный многочлен относительно переменных X

многочлен достигает минимума при таких значениях X![]()

согласно H. к. м., должны удовлетворять системе т. н. нормальных уравнений,

к-рая в обозначениях, предложенных Гауссом, имеет вид:

в результате решения системы нормальных уравнений, лишены систематич. ошибок

(EX

X

kd

d

- определитель системы (5), а d

диагональному элементу

[ a

a

словами, d

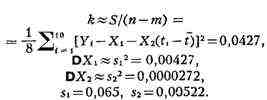

множитель пропорциональности

k (k наз. дисперсией на единицу веса)

заранее неизвестен, то для его оценки, а также для оценки дисперсии

DX,

служат

формулы: (S - минимальное значение исходной суммы квадратов). При

нек-рых общих

![]()

если количество наблюдений n достаточно велико, то абс. погрешность

приближённого равенства xj Xj меньше ts

близкой к значению интеграла (1). Если случайные ошибки наблюдении

т степенями свободы [точная оценка абс. погрешности приближённого равенства

производится здесь с помощью интеграла (2) так же, как в случае одного

неизвестного]. Кроме того, минимальное значение суммы S в вероятностном

смысле не зависит от X1, Х2,..., Xm и поэтому приближённые значения дисперсий

оценок DXj s2

H. к. м. - "выравнивание" таких результатов наблюдений Y

для к-рых в уравнениях (3) а

a

- время, то t

времени, в к-рые производились наблюдения). Особенно часто встречается

в приложениях случай т. н. параболич. интерполяции, когда a

t

a наблюдения равноточные, то для вычисления оценок X

воспользоваться таблицами ортогональных многочленов, имеющимися во многих

руководствах по современной вычислительной математике. Другой важный для

приложения случай - т. н. гармонич. интерполяция, когда в качестве a

триго-нометрич. функции [напр., a

1,2,..., т].

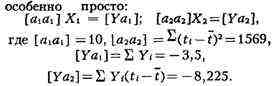

из методов хим. анализа этим методом определялась концентрация CaO в десяти

эталонных пробах заранее известного состава. Результаты равноточных наблюдений

указаны в таблице (i - номер эксперимента, t

концентрация CaO, T

в результате химического анализа, Y

систематич. ошибок, то ЕY

имеются, то в первом приближении их можно представить в виде: ЕY +

+ t

t

наз. постоянной ошибкой, а t

t

методич. ошибкой) или, что то же самое,

![]()

и достаточно оценить коэффициенты

достаточно оценить коэффициенты

х

+ t и x

t и x

Условные уравнения в данном случае имеют вид:

x

поэтому a

- t (согласно предположению о равноточности наблюдений, все

[a (t

(t

суть

![]()

на единицу веса (в данном случае k - дисперсия любой из величин

Y

T. к. в этом примере компоненты решения принимают значения X

нормальному распределению, то отношения |X

1,2) распределены по закону Стьюдента. В частности, если результаты наблюдений

лишены систематич. ошибок, o x

o x

|X

убедиться, что если действительно x

5,04 и с вероятностью 0,95 не должно превосходить 2,31. В данном случае

|X

систематич. ошибок целесообразно отвергнуть; в то же время следует признать,

что гипотеза об отсутствии методич. ошибки (x

противоречит результатам наблюдений, так как |X

наблюдения T целесообразно пользоваться приближённой формулой t

=

T

+ 0,35.

(и в частности, при оценке сложных нелинейных связей) количество неизвестных

параметров бывает весьма большим и поэтому реализация H. к. м. оказывается

эффективной лишь при использовании современной вычислительной техники.

вероятностей, 4 изд., M., 1924; Колмогоров A. H., К обоснованию метода

наименьших квадратов, "Успехи математических наук", 1946, т. 1, в. 1; Л

и н н и к Ю. В., Метод наименьших квадратов и основы ма-тематико-статистической

теории обработки наблюдений, 2 изд., M., 1962; Helmert F. R., Die

Ausgleichungsrechnung nach der Methode der kleinsten Quadrate..., 2 Aufl.,

Lpz., 1907. Л. H. Большее.